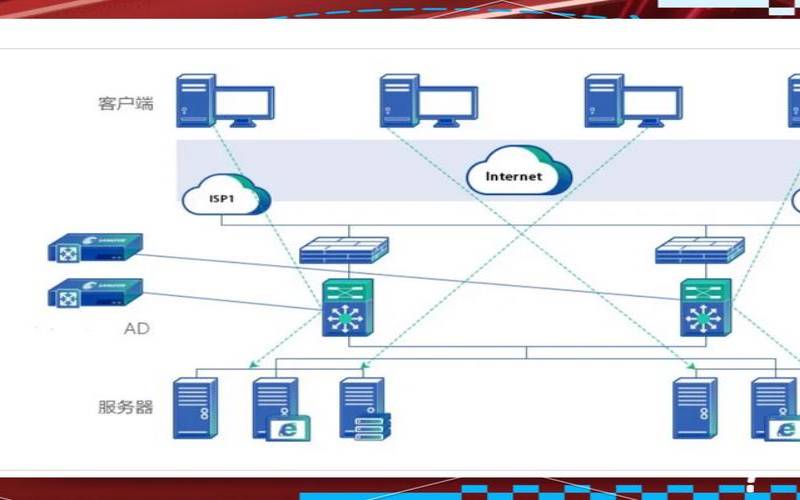

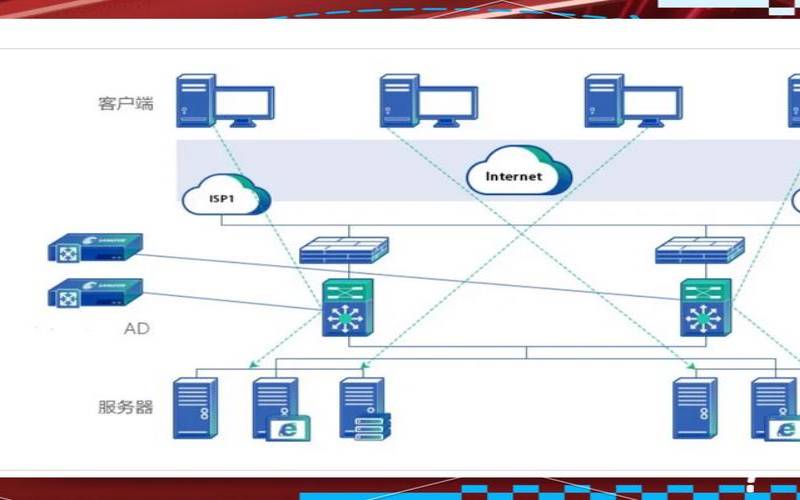

在现代互联网架构中,Web服务器的负载均衡和高可用性是确保服务稳定与用户体验的重要因素。通过合理的策略和工具,可以有效分散流量、提高系统的容错能力。本文将探讨负载均衡的基本概念、实现方法以及常见解决方案。

负载均衡是指将用户请求合理分配到多台服务器上,以避免单一服务器的过载,从而提升整体性能和响应速度。它可以在应用层、传输层或网络层实施,确保资源利用最大化。

高可用性指系统在长时间运行中保持可用的能力,通常通过冗余和故障转移来实现。当一台服务器出现故障时,流量可以自动转移到其他健康的服务器上,从而减少服务中断的风险。

使用专用的硬件设备,如负载均衡器,通过智能流量分配算法(如轮询、最少连接、IP哈希等)来实现负载均衡。硬件设备通常性能强大,但成本较高。

通过软件解决方案(如Nginx、HAProxy)实现负载均衡。这种方式灵活且成本相对较低,适合大多数中小型企业。软件负载均衡器可以运行在普通服务器上,配置简单。

将多台服务器配置为集群,通过共享负载和冗余实现高可用性。在集群中,任意一台服务器故障时,其他服务器可以接管其工作。

Nginx是一款高性能的HTTP服务器和反向代理服务器,广泛用于负载均衡和高可用性。其支持多种负载均衡算法,易于配置,适合处理大量并发连接。

5.2AWSElasticLoadBalancing

亚马逊云服务提供的ElasticLoadBalancing(ELB)能够自动分配流量到多台EC2实例,支持自动扩展与故障检测,确保高可用性。

Kubernetes作为容器编排平台,通过服务发现和负载均衡功能,能够在容器集群中实现高可用性和动态负载均衡。

实现Web服务器的负载均衡和高可用性是现代网络架构中的关键环节。通过合理选择负载均衡和高可用性的解决方案,企业能够有效提升系统的性能与可靠性,从而提升用户体验。

本文来源:独立服务器--如何实现Web服务器的负载均衡和高可用性(web服务器负载架构)

本文地址:https://www.idcbaba.com/duli/4364.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 1919100645@qq.com 举报,一经查实,本站将立刻删除。